机器人在复杂真实环境中的操作常常面临感知不足的挑战——在关键时刻的一瞬间信息不够:末端执行器靠近物体时,腕部或第三视角相机易被遮挡;执行器与物体发生交互时,触觉传感器只能在接触后提供局部信号,难以覆盖接触前的精准定位与接触过程中的连续纠偏。在视觉受限而触觉未被激活的“最后一厘米”关键阶段,环境感知能力的空白使机器人在精细和接触丰富的任务中表现受限。

为解决“感知断档”这一问题,北京大学朱毅鑫助理教授团队联合北京通用人工智能研究院提出TacThru:一种透视皮肤(STS)传感器,通过全透明弹性体+持续内部照明+关键线定位点实现指尖视角下同步的视觉-触觉感知;并进一步提出 TacThru-UMI 学习框架,将腕部视觉、TacThru 传感信号与机器人本体感知统一接入基于 UMI 的仿真学习框架,让机器人在无需人工设计规则的情况下,从示范中学会“该看时看、该摸时摸”的多模态协同策略。

在 5 项真实世界操作任务上,TacThru-UMI 取得 85.5% 的平均成功率,明显优于触觉基线(66.3%)与纯视觉基线(55.4%),尤其在薄软物体、精细识别、精密插入等场景中体现出稳定优势。相关论文 Simultaneous Tactile-Visual Perception for Learning Multimodal Robot Manipulation已被 IEEE Robotics and Automation Letters(RA-L) 接收。

图1. 论文截图

作为机器人的两项重要感知能力,视觉与触觉感知往往被割裂成两套系统:视觉(腕部/外部相机)提供全局信息,包括物体位置、环境状态、任务进度等;触觉(指尖传感器)提供局部接触信息,包括接触状态、摩擦力大小等。

然而,当机器人靠近物体时,其末端执行器容易遮挡要操作的物体,而触觉传感器又只能在接触发生后才能提供稀疏、局部的感知信号。在视觉遮挡发生后、触觉接触发生前的关键阶段,视觉与触觉同时失效,使机器人无法获得对末端执行器附近空间与物体的有效感知。

于是,一个更本质的问题浮现:能不能把“视觉”和“触觉”做成同一个指尖上的连续信号流,并且让学习算法直接用这些信号学会操作?

TacThru 的答案非常直接:把指尖变成一个持续在线的近景窗口,通过图像信号同时传递指尖视角下的视觉与触觉感知——在接触前“看得清”,在接触中“摸得准”,在整个任务过程中不切换模式、持续不断流。

TacThru 的工作原理可理解为把两种传感模态集成在机器人指尖中,在同一视角下同步稳定输出可用的“近距离视觉(接近觉)+ 触觉形变/剪切”信号;在学习系统层面,通过模仿学习,让策略学会自适应地选择和利用多模态信息,用于决策操作动作。

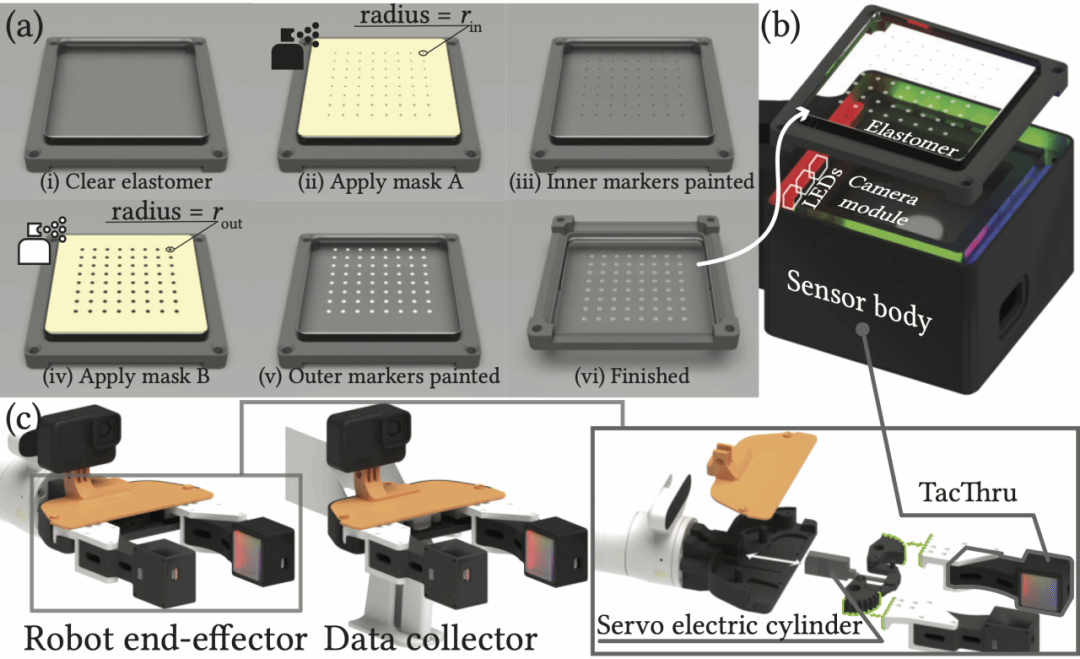

图2. TacThru 传感器的制造过程与 TacThru-UMI 系统集成

传感器设计:透明弹性体+持续照明,实现真正同步的视触觉感知

现有透视皮肤传感器(STS)的设计通常需要在视觉成像质量与触觉感知能力之间进行权衡。具体而言,若希望获得清晰的近距离视觉图像,硅胶形变层通常需要具有较高的光学透明度,以减少对外部场景成像的遮挡;而若希望通过视触觉方法估计接触形变,则往往需要依赖反射涂层、定位点或特定照明条件,以便通过几何重建或光学变化推断接触形变。许多现有方案通过切换照明状态或机械结构,在“视觉模式”和“触觉模式”之间交替运行。然而,该类方案会在时间上将两种感知模态强制分离,导致任一时刻只能获得单一模态信息,并增加系统控制逻辑的复杂度。

TacThru的设计目标是避免这种模态切换带来的信息断档。为此,TacThru采用全透明硅胶形变层作为指尖弹性体,使内置相机能够持续观察到外部环境中的物体外观、边缘结构及其相对位姿变化。同时,系统持续开启内部照明,从而在同一时刻的图像中同时保留外部视觉信息与传感器表面定位点图案,而无需在视觉与触觉模式之间进行切换。

在该设计下,传感器获取的单帧图像同时包含两类信息:一类是透过透明弹性体获取的外部环境视觉图像,用于提供近距离视觉(接近觉)上下文;另一类是弹性体表面定位点的图案变化,用于反映接触过程中的形变趋势与剪切信息。该设计优先保证机器人操作学习所需的这两类关键信号,而不依赖复杂的三维几何重建过程恢复精确深度。

关键线定位点:提高复杂背景下的可检测性

透明弹性体虽然能够显著提升视觉信号质量,但也会引入新的挑战:外界环境中的纹理、文字或边缘结构会直接进入传感器相机图像,从而干扰定位点检测。传统透视皮肤传感器通常采用单色实心定位点(例如黑色圆点)。在复杂背景条件下,该设计容易产生两类问题:

第一类问题是漏检。当定位点颜色与背景颜色或纹理相近时,其边缘对比度会显著降低,导致定位点难以与背景区分,从而无法被检测算法识别。

第二类问题是误检。复杂环境中的斑点状纹理或字符图案可能与定位点形态相似,从而被误识别为定位点,导致触觉信号中混入环境噪声。

为提高定位点在复杂背景下的可检测性,TacThru 引入关键线定位点结构。该结构借鉴平面设计领域中“关键线”的概念,即通过高对比度边界来明确区域轮廓。具体而言,每个定位点由黑色内圈与白色外圈构成的同心结构组成,从而形成稳定且高对比度的环形边界。即使在复杂背景下,该边界仍能够提供清晰的视觉特征,提高定位点检测算法的稳定性。

图3. 关键线定位点设计与滤波方法实现鲁棒追踪

稳健高频追踪:卡尔曼滤波+连续性约束

仅依赖定位点结构设计仍不足以完全消除检测误差。在实际操作过程中,接触形变可能剧烈变化,且外界环境图像具有高度不确定性,因此仍可能出现短暂误检或漏检。为进一步提高定位点追踪的稳定性,TacThru 采用轻量级的时序追踪策略对检测结果进行过滤。

具体而言,系统为每个定位点维护一个状态变量,用于表示其在图像中的位置,并使用卡尔曼滤波根据历史轨迹预测下一帧的位置。在每一帧中,首先通过图像处理获得候选点集合,然后根据上一时刻的预测位置执行最近邻匹配,完成数据关联,从而识别最可能对应的定位点观测。同时引入运动连续性约束:若当前观测与预测位置之间的偏差超过合理范围,则暂时拒绝更新,以避免异常观测对追踪结果造成干扰。

此方法计算复杂度较低,可在CPU上高效运行。论文实验结果表明,该追踪算法能够支持约 120 Hz 的更新频率,从而减少多模态信号之间的时间错位,并为实时控制与策略学习提供稳定的输入。

TacThru-UMI:把同步多模态观测直接接入扩散策略

TacThru 传感器设计能够稳定获取多模态感知信号,但这些信号仍需被有效整合到机器人策略学习系统中,才能转化为可执行的操作行为。

在 TacThru-UMI 中,策略同时接收四类观测信息,并通过 Transformer 结构在时间维度与模态维度上进行动态注意力分配:

1) 腕部相机:提供操作场景的全局视觉信息,例如目标物体位置、环境结构及整体空间布局;

2) TacThru 指尖图像:提供接近目标物体时的近距离视觉信息,可反映接触前后的局部几何结构、遮挡变化及细粒度外观特征;

3) 定位点位移(触觉信号):通过弹性体表面定位点的位移变化反映接触形变与剪切趋势,可用于判断接触状态,例如是否发生接触、是否产生滑动或是否完成插入等;

4) 机器人本体状态:包括末端执行器位姿、夹爪开合宽度等信息,用于描述机械臂当前的运动状态与控制上下文。

上述多模态观测首先被编码为统一的特征表示(token),随后输入到基于Transformer 的扩散策略学习输出一段动作序列。策略不需要手工写规则去切换视觉/触觉模式,而是从示范数据中学会在不同阶段利用不同模态,这种多模态协同机制正是同步视触觉感知在机器人操作学习中的关键优势。

图4. 策略结构:多模态观测被编码为token,并输入基于Transformer的扩散策略模型,通过逐步去噪高斯噪声生成机器人动作片段

团队在真实机器人上设计了五个任务,覆盖典型的接触密集型任务难点,并评估不同模态组合。五个任务分别强调不同能力:

图5. 五种操作任务场景中的示范过程

1.抓取瓶子:基础抓取放置,验证学习框架不拖后腿

在相对基础的抓取-放置操作场景下,多数方法都能达到很高成功率。这一任务的意义不是拉开差距,而是确认TacThru-UMI 能稳定完成示范学习与部署,且引入额外模态不会降低基本操作能力。

图6. 瓶子抓取任务的标准执行过程

2.抽取纸巾:薄软纸巾几乎“摸不到”,但依然“看得见”

抽取纸巾看似简单,却对机器人要求非常苛刻:纸巾薄、软、轻,接触压力可能非常微弱,传统触觉对是否抓住、是否滑走的判断不够可靠,而腕部相机在近距离也容易因遮挡与分辨率限制看不清。

TacThru 的优势在这里非常直观:指尖接近觉能持续观察纸巾边缘与相对位置变化,当纸巾打滑或未抓牢时,策略更容易触发纠错(比如重新抓取或调整夹爪宽度),而不是继续进行失败动作。

图7. TacThru能检测由抓取不牢或噪声引起的偶发滑动,并通过自动重试进行纠正

3.螺栓分拣:腕部看不清、触觉分不出,但指尖接近觉能看清细节

螺栓分拣任务的主要难点在于目标物体尺寸较小且外观相似。由于腕部相机与操作区域之间存在一定距离,其获取的图像信息难以稳定分辨螺栓之间细微的几何差异或颜色特征;而仅依赖触觉信息则难以区分颜色,并且在几何形状高度相似的情况下也容易产生混淆。因此,单一模态往往难以在该任务中提供可靠的判别依据。

TacThru 提供的指尖近景视觉能够有效弥补这一不足。当夹爪抓取物体后,物体会自然进入指尖相机的近距离视野,使策略能够在更高分辨率的图像中观察到更稳定的外观信息以及局部几何与颜色特征。通过利用这些近距离视觉线索,策略能够更准确地完成物体分类,从而提高分拣任务的可靠性。

论文还通过特征可视化显示:TacThru 图像的表征聚类更清晰,意味着策略确实学到了对区分有用的视觉线索。

图8. 将黑色圆头螺栓分拣入橙色碗中

4.悬挂剪刀:视觉难判断“是否挂上”,触觉位移提供关键完成信号

悬挂剪刀任务属于典型的完成状态判定问题。在该任务中,即使视觉信息能够观测到剪刀已接近钩子,在存在遮挡以及二维视角限制的情况下,仍难以仅凭视觉信号准确判断剪刀是否已经成功被挂上。而这一时刻的判定直接决定机器人何时释放夹爪:若释放过早,剪刀可能尚未稳定挂接而掉落;若释放过晚,则可能导致剪刀与钩子发生卡滞或干涉。

TacThru 提供的定位点位移信息能够反映接触过程中的形变与剪切变化。当剪刀真正挂接在钩子上时,弹性体表面的受力分布及其形变模式会发生明显变化。策略模型可以利用这些变化作为触觉层面的任务完成证据,从而更可靠地判断释放夹爪的时机。相比之下,仅依赖视觉信号在遮挡和视角受限条件下难以稳定实现这一判定。

图9. 触觉证据检测到首次尝试失败,重试后成功完成任务

5.插入瓶盖:可见时用视觉伺服,不可见时用触觉引导

插入类操作任务最能充分体现同步视触觉感知的优势。在该类任务中,当目标接口在视觉上可见时,视觉信息可以直接用于精细对齐,例如通过类似视觉伺服的方式逐步调整末端执行器位置。然而,在实际操作过程中,目标接口常常会被夹爪或被操作物体遮挡,从而导致视觉信息退化。在这种情况下,触觉信号便成为继续推进插入过程并进行误差修正的重要信息来源。

TacThru 的关键优势在于:同一传感器能够在同一时刻同时提供视觉与触觉两类信号。在策略学习框架中,这两类信息可以被统一输入并由模型自动进行融合。因此,在执行过程中,策略可以在接口可见时更多依赖视觉信息进行对齐,而在视觉受遮挡时转而利用触觉信号进行状态判断与误差修正,而无需通过手工规则显式切换感知模式。论文实验表明,该多模态协同机制能够在插入类任务中提高策略的稳定性与成功率。

图10. 在接近阶段安装座清晰可见,系统能利用接近觉进行主动对齐

图11. 安装座被抓取姿态遮挡,策略转而使用触觉感知作为补充

总体量化性能

综合五个任务的实验结果,TacThru-UMI 的平均成功率达到 85.5%,明显优于触觉基线(66.3%)和纯视觉基线(55.4%)。更重要的是,差距主要来自真实世界最棘手的阶段:薄软物体接触、遮挡条件下的状态判断、精密对齐插入等,这些阶段往往也是单一感知模态最容易出现信息断档或判断困难的情形。

图12. 不同操作任务与感知模态下的定量结果。其中:TT-M是带有定位点信息的 TacThru;TT仅使用 TacThru 图像;GS-M是带定位点信息的 GelSight;Wrist仅使用腕部相机视觉

从更长远视角看,TacThru 的意义不仅在于提出一种新的指尖传感器设计,更在于提供了一种更适合学习系统的感知方式:将来自不同模态的信息以持续、同步且可标准化的形式输入到策略网络中,从而支持多模态协同的机器人操作学习。

同步多模态感知更适合策略学习

在许多传统系统中,多模态信息融合往往通过显式控制逻辑实现,例如利用距离阈值判断是否接近目标等。这类方法在特定任务中适用,但通常依赖人工设计规则,在任务变化或环境复杂度增加时往往难以泛化,同时也增加了系统维护成本。TacThru-UMI 的设计表明,当视觉与触觉信号能够持续且同时获得时,策略模型可以直接从示范数据中学习不同模态在任务不同阶段的作用。这种由学习模型自动完成的多模态协同机制,能够减少对人工规则的依赖。

对遮挡与近距离精细操作更友好

腕部相机通常能够提供较好的全局场景信息,但在操作末端阶段往往容易受到遮挡影响,从而降低视觉信息的可靠性。TacThru 将近距离视觉观测点布置在机器人指尖位置,使系统能够在接触附近持续获取局部视觉信息,从而覆盖“最后几厘米”的关键阶段。对插入、挂取、精细分类与对齐等任务,这种近景窗口的价值往往远大于再增加一个远处相机。

指尖图像中包含弹性体结构、定位点以及形变等因素,与传统相机图像存在一定差异,因此可能引入新的视觉域差。然而,论文实验结果表明,标准的预训练视觉编码器仍能够有效提取其中的关键特征。这意味着 TacThru 可以作为对现有系统的一种扩展,较容易地接入现有视觉学习框架。

开放系统设计有助于进一步研究

论文公开了传感器结构设计、定位点方案以及追踪方法,并将其与 UMI 及扩散策略等常见学习框架结合。这种设计使得后续研究能够在现有系统基础上进一步扩展,例如增加更多操作任务、构建更大规模的数据集,或结合触觉仿真与预训练方法,从而进一步提升机器人操作策略的泛化能力。

TacThru 通过“全透明弹性体+持续照明+关键线定位点+高效追踪”,实现了指尖位置的同步视觉与触觉感知;TacThru-UMI 则进一步证明当同步视触觉信号能以标准化形式进入现代学习框架时,机器人可以从示范中学到更接近人类的多模态协同策略。

这一研究表明:将感知能力部署在机器人操作最关键的接触区域,并以同步多模态形式直接接入学习系统,是提升复杂操作能力的一种有效途径。这为机器人在接触密集和精细操作场景中的学习与应用提供了新的技术路径。

论文共同第一作者为北京大学人工智能研究院博士生李宇飏、北京大学23级通班陈应涵;通讯作者包括北京大学心理与认知科学学院及人工智能研究院助理教授朱毅鑫以及北京通用人工智能研究院研究员刘腾宇、黄思远。